В прошлой статье мы разобрали теорию паттерна Интерпретатор, узнали что такое AST-дерево и как абстрагировать терминальные и нетерминальные выражения. На этот раз давайте отойдем от теории и посмотрим, как этот паттерн применяется в серьезных коммерческих проектах, которыми мы все пользуемся ежедневно!

Спойлер: Вы, возможно, пользуетесь паттерном Интерпретатор прямо сейчас, просто читая этот текст в браузере!

Один из самых ярких и, пожалуй, самых важных примеров использования этого паттерна в индустрии — это JavaScript. Язык, который изначально создавался “на коленке”, сегодня работает на миллиардах устройств именно благодаря концепции интерпретации.

10 дней, которые перевернули интернет

История создания JavaScript полна легенд. В 1995 году Брендан Эйх (Brendan Eich), работая в Netscape Communications, получил задание: создать простой скриптовый язык, который мог бы выполняться прямо в браузере (Netscape Navigator), чтобы делать веб-странички интерактивными. Руководство хотело что-то с синтаксисом, похожим на сверхпопулярный тогда Java, но предназначенное не для профессиональных инженеров, а для веб-дизайнеров.

У Эйха было всего 10 дней на написание первого прототипа языка, который тогда назывался Mocha (затем LiveScript, и только потом JavaScript из маркетинговых соображений). Спешка была не случайной: на пятки наступала корпорация Microsoft, которая в это же время активно готовила свой собственный скриптовый язык VBScript для встраивания в браузер Internet Explorer. Netscape нужно было срочно выпустить свой ответ, чтобы не проиграть в надвигающейся браузерной войне.

Времени писать сложный компилятор в машинный код просто не было. Очевидным и самым быстрым решением для Эйха стала архитектура классического Интерпретатора.

Первый интерпретатор (SpiderMonkey) работал так:

- Он читал текстовый исходный код скрипта со страницы.

- Лексический анализатор разбивал текст на токены.

- Парсер строил Абстрактное Синтаксическое Дерево (AST). В терминах паттерна Интерпретатор это дерево состояло из терминальных выражений (строки, числа вроде 42) и нетерминальных (вызовы функций, операторы вроде If, While).

- Затем виртуальная машина шаг за шагом “обходила” это дерево, выполняя заложенные в нем инструкции у каждого узла (вызывая метод, аналогичный Interpret()).

Контекст (Context) и Объекты

Помните объект Context, который мы должны были передавать в метод Interpret(Context context) в классической реализации? Он нужен интерпретатору для хранения текущего состояния памяти.

В случае с JavaScript роль этого контекста на верхнем уровне играет Глобальный объект (например, window в браузере). Когда ваш AST-узел пытается, скажем, вывести текст на экран через document.write(“Hello”), интерпретатор обращается к своему контексту (объекту document) и вызывает нужный внутренний API браузера.

Именно благодаря интерпретатору JavaScript смог так легко взаимодействовать с DOM (Document Object Model) — всё это просто объекты в контексте, к которым обращаются узлы дерева.

Эволюция интерпретатора: JIT Компиляция

Исторически JS в браузерах долгое время оставался “чистым” интерпретатором. И у этого был большой минус — медленная скорость. Парсинг дерева и медленный обход каждого узла при каждом выполнении скрипта тормозил сложные веб-приложения.

С появлением движка V8 от Google (встроенного в Chrome) в 2008 году произошла революция. Инженеры поняли, что одного интерпретатора недостаточно для современного веба. Движок усложнился: он по-прежнему строит AST-дерево, но теперь использует JIT (Just-In-Time) компиляцию.

Современные JS-движки (V8, SpiderMonkey) работают как сложный конвейер:

- Быстрый и “тупой” базовый интерпретатор начинает выполнять ваш JS код моментально, даже не дожидаясь его компиляции (здесь по-прежнему работает классический паттерн).

- Параллельно, движок отслеживает “горячие” участки кода (циклы или функции, которые вызываются тысячи раз).

- Эти участки компилируются JIT-компилятором напрямую в оптимизированный машинный код, минуя медленный интерпретатор.

Именно это сочетание моментального старта интерпретатора и вычислительной мощи компиляции позволило JavaScript захватить мир, став языком серверов (Node.js) и мобильных приложений (React Native).

Интерпретатор в игровой индустрии

Несмотря на доминирование C++ в тяжелых вычислениях, паттерн Интерпретатор является индустриальным стандартом в геймдеве для создания игровой логики. Зачем? Чтобы геймдизайнеры могли делать игры без риска «уронить» движок или необходимости его постоянно перекомпилировать.

Отличным историческим примером является UnrealScript — язык, на котором была написана логика игр серий Unreal Tournament и Gears of War в Unreal Engine 1, 2 и 3. Текст компилировался в компактный байт-код абстрактной машины, который затем шаг за шагом 해석(интерпретировался) виртуальной машиной движка.

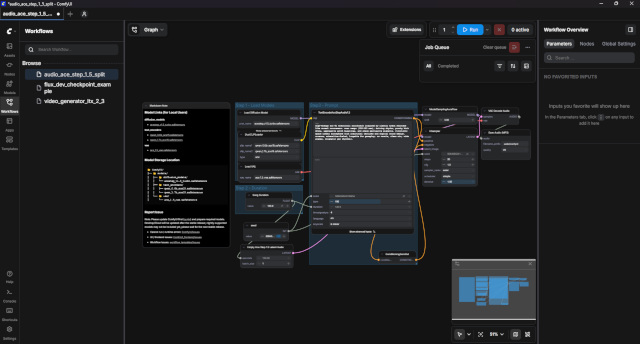

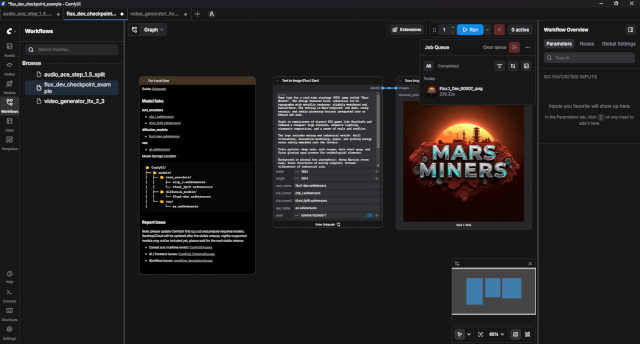

Визуальные граф-скрипты (Blueprints)

Сегодня на смену тексту пришло визуальное программирование — система Blueprints в Unreal Engine 4 и 5.

Если вы когда-либо открывали Blueprint в Unreal Engine, вы видели множество блоков-узлов (Nodes), соединенных «проводами». Архитектурно, весь граф Blueprints — это огромное Абстрактное Синтаксическое Дерево (AST), нарисованное на экране:

- Терминальные выражения (Terminal Expressions): Узлы-константы. Например, узел, который просто хранит число 42 или строку. Они возвращают конкретное значение при интерпретации.

- Нетерминальные выражения (Non-Terminal Expressions): Вычислительные узлы (сложение Add) или узлы контроля потока (Branch). У них есть входы-аргументы, которые интерпретатор сначала рекурсивно вычисляет, прежде чем выдать результат на выходной пин.

А роль контекста здесь играет память экземпляра конкретного игрового объекта (Actor). Interpreter Machine безопасно “гуляет” по этому графу, запрашивая данные и выполняя переходы.

Где еще используется Интерпретатор?

Паттерн интерпретатор можно найти практически в любой сложной системе, где требуется выполнять динамические инструкции. Вот лишь несколько примеров из коммерческого ПО:

- Интерпретируемые языки программирования (Python, Ruby, PHP). Весь их рантайм базируется на классическом паттерне. Например, эталонная реализация CPython сначала парсит ваш .py скрипт в AST, компилирует его в байт-код, а затем огромная виртуальная машина (цикл вычисления) интерпретирует этот байт-код шаг за шагом.

- Java Virtual Machine (JVM). Изначально Java код компилируется не в машинные инструкции, а в байт-код. Когда вы запускаете приложение, JVM работает как интерпретатор (правда, с агрессивной JIT-компиляцией, как и в V8).

- Базы данных и SQL. Когда вы отправляете SQL-запрос (SELECT * FROM users) в PostgreSQL или MySQL, движок базы данных выступает в роли интерпретатора. Он проводит лексический анализ, строит AST-дерево запроса, генерирует план выполнения и затем буквально «интерпретирует» этот план, перебирая строки таблиц.

- Регулярные выражения (RegEx). Любой движок регулярных выражений внутри парсит строковый паттерн (например, ^\d{3}-\d{2}$) в граф состояний (NFA/DFA Автомат), по которому затем проходит внутренний интерпретатор, сопоставляя каждый вводимый символ с вершинами этого графа.

- Unity Shader Graph / Unreal Material Editor — интерпретируют визуальные узлы в модульный шейдерный код (GLSL/HLSL).

- Blender Geometry Nodes — интерпретируют математические и геометрические операции для процедурной генерации 3D-моделей в реальном времени.

Итог

Паттерн Интерпретатор давно вышел за рамки «написать свой калькулятор». Это мощнейший индустриальный стандарт. От JavaScript-движков, которые ежедневно исполняют гигабайты кода за кулисами браузеров, до игровых конструкторов, позволяющих строить сложную логику без знания C++ — интерпретаторы остаются одной из важнейших архитектурных концепций в современной IT-разработке.